Artículo de Reflexión

Dilemas éticos planteados por el auge de la inteligencia artificial: una mirada desde el transhumanismo

Ethical dilemmas posed by the rise of artificial intelligence: a view from transhumanism

Fernando Antonio Zapata Muriel1 ![]() *, Santiago Montoya

Zapata2

*, Santiago Montoya

Zapata2 ![]() *, Diego Montoya-Zapata3

*, Diego Montoya-Zapata3 ![]() *

*

RESUMEN

El uso de la inteligencia artificial ha generado diversas preocupaciones y discusiones, especialmente sobre los posibles riesgos y consecuencias que puede acarrear si no se observan críticamente los principios éticos. La recolección de la información se realizó mediante los métodos de investigación documental y hermenéutico, en los que prima la interpretación y el análisis crítico, seguido del estudio de referentes bibliográficos relevantes en torno a estos tópicos. Los resultados fueron triangulados con las respuestas dadas por el chat de inteligencia artificial (ChatGPT 3.5) en lengua española. Se constató que, entre el ser humano, el transhumano y la inteligencia artificial existen grandes diferencias, generadoras hoy de distintos dilemas éticos y espiritual-trascendentes, que pueden hacer que la máquina inteligente se pueda convertir en un peligro para la humanidad. Conceptos como singularidad, autonomía, conciencia, toma de decisiones, libertad, entre otros, permiten atisbar la diferencia entre la máquina programada, automatizada con determinada funcionalidad y la autonomía humana. Se concluye que no todo lo tecno-científicamente posible es éticamente aceptable, como tampoco es posible equiparar la máquina inteligente programada mediante algoritmos, con ser humano capaz de: tener autoconciencia, autodeterminación, pensar su existencia, ser consciente de su singularidad, entre otras diferencias claves.

Palabras clave: problemas sociales, sociedad de la información, sociedad postindustrial, tecnología de la información.

Clasificación JEL: I20, I121, I30

ABSTRACT

Artificial intelligence has generated several concerns and discussions, especially about the possible risks and consequences if ethical principles are not critically observed. Information was collected through documentary and hermeneutic research methods, in which interpretation and critical analysis prevail, followed by the study of relevant bibliographic references on these topics. The results were triangulated with the answers from the artificial intelligence chat (ChatGPT 3.5) in Spanish. It was found that there are significant differences between human beings, transhuman, and artificial intelligence, generating different ethical and spiritual-transcendent dilemmas today, which can make the intelligent machine a danger to humanity. Concepts such as singularity, autonomy, conscience, decision-making, and freedom, among others, allow us to glimpse the difference between the programmed, automated machine with certain functionality and human autonomy. It is concluded that not everything techno-scientifically possible is ethically acceptable, nor is it possible to equate the intelligent machine programmed by algorithms with human beings capable of self-awareness, self-determination, thinking about their existence, and being aware of their uniqueness, among other vital differences.

Keywords: social problems, information society, post-industrial society, information technology.

JEL Classification: I20, I121, I30

Recibido: 20-10-2023 Revisado: 02-12-2023 Aceptado: 20-12-2023 Publicado: 15-01-2024

Editor:

Carlos Alberto Gómez Cano ![]()

1 Corporación Universitaria Remington. Medellín, Colombia.

2 Ikergune A.I.E. Grupo INZU. Elgoibar, España.

3 École nationale supérieure d’Arts et Métiers. París, Francia.

Citar como: Zapata, F., Montoya, S. y Montoya-Zapata, D. (2024). Dilemas éticos planteados por el auge de la inteligencia artificial: una mirada desde el transhumanismo. Región Científica, 3(1), 2024225. https://doi.org/10.58763/rc2024225

INTRODUCCIÓN

El ser humano es un ser vivo (bios), un ser holista, integral y pluridimensional. Esto significa que debe ser entendido como un ser en el mundo, cuya naturaleza es histórica y es consciente de su existencia, lo que le permite construir propósito y dar sentido a su vida.

Como entidad material, viva, dinámica, se ha encontrado llamada al cambio interno y externo a través del tiempo. El ser humano es espiritual y capaz de trascender su existencia concreta, de construir un sentido de vida y establecer relaciones con los demás seres vivos y con el entorno. Además, el ser humano es conciencia, vive el presente, por lo que valora el aquí y ahora. Por tanto, se puede afirmar que el ser humano es voluntad y cuenta con la capacidad de decidir y discernir su querer ser, su propósito. En definitiva, el ser humano es ético, capaz de reflexionar en torno a lo que es bueno y a seguirlo como norma de vida.

En este sentido, es un ser social, capaz de relaciones de otredad como reconocimiento de su propia humanidad. El ser humano es autónomo, digno de respeto, libre, capaz de elegir y de auto determinarse, con cierta consciencia de hasta dónde llegan sus derechos y hasta dónde van sus deberes para con el otro. Desde esta perspectiva, el ser humano es persona, en cuanto es consciente, libre y responsable. Por ello cabe inquirir: ¿Puede hablarse de dilemas éticos y espiritual-trascendentes en torno al transhumanismo y a la inteligencia artificial? Al afirmar tal realidad, ¿Cómo identificar e interpretar dichos dilemas éticos y/o espiritual-trascendentes?

Es necesario precisar que un dilema ético aparece cuando el profesional enfrenta dos o más alternativas de solución posibles en un ambiente determinado o una situación, en la que están presentes algunos principios éticos que, al ser violados, pueda verse el sujeto involucrado en una situación tan comprometedora. Esto puede interpretarse como el acto de cometer una arbitrariedad sin importar la naturaleza acertada o desacertada, la omisión o falta a un código religioso o civil, de ahí que se conciba como un problema ético (Kvalnes, 2019). En consecuencia, un dilema ético-trascendente espiritual genera un problema, al ser violados algunos valores y criterios originando eventos o situaciones en los que algunos valores éticos entran en conflicto, llegando a generar respuestas ético-morales intolerables.

METODOLOGÍA

La recolección de información en este estudio se realizó siguiendo, en primer lugar, el método de investigación documental a través de la lectura de revistas, documentos, libros, conferencias, de la escucha de grabaciones, documentales, periódicos. Este tipo de estudios facilita no solo la recolección de datos, sino la evaluación de documentos, la elaboración de nuevas interrogantes, comprender el cambio en las tendencias en un periodo de tiempo o triangular información (Bereczki y Kárpáti, 2021; Dalglish et al., 2020; Kayesa y Shung-King, 2021).

En segundo lugar, se empleó el método hermenéutico para el análisis, comparación y discusión de los principales referentes bibliográficos en torno a estos tópicos, lo que permitió generar un horizonte de sentido a través del lenguaje y la consciencia compartida (Elbanna y Newman, 2022). En las ciencias sociales admitir que el sentido es el ámbito objetual supone reconocer las transformaciones lingüísticas que matizan dicho horizonte sentido, de ahí la necesidad de comprender el fenómeno desde la experiencia humana en sí y su proyección en el lenguaje (Santiago et al., 2020).

Esta búsqueda y posterior análisis se complementó con el examen crítico de las respuestas dada por el ChatGPT 3.5 en lengua española a 34 preguntas elaboradas por los investigadores en torno a la ética, la existencia, lo espiritual trascendente, la autonomía y la conciencia, entre otros. Dicha aproximación al uso de los grandes modelos de lenguaje ha probado ser útil en diversos estudios previos, al permitir señalar limitaciones, fortalezas e incongruencias en las respuestas dadas (Graf Y Bernardi, 2023; Gravel et al., 2023; Sohail et al., 2023).

RESULTADOS

Del ser humano al transhumanismo y a la inteligencia artificial

El ser humano ha sido sujeto de estudio a lo largo de la historia, en cambio lo transhumano aparece como una novedad desde mediados del siglo xx hasta hoy. El ser humano puede concebirse como un ser holista, singular e irrepetible, es un ser pluridimensional, lo que se expresa en su naturaleza eco-bio-psico-socio-existencial, según Kant, y sistematizadas en un modelo que atraviesa varias disciplinas científicas (Stilwell y Harman, 2019).

De este modo, el transhumanismo puede definirse como un movimiento cultural, científico e intelectual cuya propuesta es mejorar las habilidades físicas y cognitivas de los seres humanos mediante la aplicación a estas novedosas tecnologías, con el fin de prescindir de algunos aspectos de su condición humana: enfermedad, sufrimiento, vejez y muerte (Battle Fisher, 2020; Laakasuo et al., 2021).

Por su parte, la locución inteligencia artificial implica el diseño de modelos que guíen a una máquina o sistema de ellas a comportarse y decidir de manera inteligente, en referencia frecuente a la imitación de aspectos esencialmente humanos de ambos procesos (Collins et al., 2021). En términos de González Arencibia y Martínez Cardero (2020), esta conjuga un sistema de símbolos, capaces de simular comportamientos humanos, desde programas informáticos y se basa en la resolución de problemas, desde sistemaseficientes y escalables.

Sin embargo, estos autores destacan su carácter autómata, en tanto son regidos por personas y su función depende de personas humanas capaces de diseñar y programar a través de algoritmos para manipular y automatizar a la máquina-máquina o a la máquina-humana. Esto les hace perder la singularidad; adolecen de libertad, conciencia y dignidad, entre otros elementos determinantes para hablar de autonomía y de persona humana.

Antes de profundizar en este concepto vale la pena referenciar la inteligencia como elemento clave de esa dimensión racional del hombre capaz de posibilitar no sólo un desarrollo del coeficiente intelectual o de resolver problemas sino aún más, capaz de posibilitar la autodisciplina, el autocontrol y el dominio de sí. En la segunda mitad del siglo xx varios teóricos amplían el concepto; aparecen expresiones como inteligencias múltiples (Gardner, 1994), inteligencia emocional con Mayer y Sallovey (1997), Goleman (1995); inteligencia social (Goleman, 2006) e inteligencia artificial; constructo vislumbrado desde los años 30 con la máquina de Turing y acuñado en la Dartmouth University en 1956 (Zhang y Lu, 2023).

Entre las inteligencias múltiples, se destaca la inteligencia intrapersonal, en la que se acentúan los procesos de autoconciencia (Aksu et al., 2023; González Treviño et al., 2020; He et al., 2023). Igualmente, en el ámbito de la inteligencia emocional, se ponen de relieve cinco características distintivas esenciales el autoconocimiento, la automotivación y el autocontrol, la asertividad y la capacidad para reconocer la emoción en los otros (Butler et al., 2022; Walker et al., 2022; Zhang et al., 2022).

Por su parte, Torralba (2010) define la inteligencia espiritual como algo peculiar de cada ser humano, visible en grados distintos de desarrollo y que consiste en la capacidad de anhelo de integración del propio ser con una realidad más grande que la suya. A tal efecto, el hombre dispone de la capacidad para encontrar el camino ideal que lo llevará a tal meta. Con este concepto como guía, se han realizado múltiples intervenciones y estudios encaminados al bienestar humano y el desarrollo en distintas áreas (personal, profesional, interpersonal) (Alshebami et al., 2023; Teixeira Pinto y Pinto, 2022; Sharifnia et al., 2022).

Por esta razón, se coincide con lo revisado en la literatura en el sentido de que la ia consiste en dotar a la máquina de funciones cognitivas y que para su entrenamiento se urge de datos que les permitan ejercer ciertas funciones (Mariani et al., 2023). En este sentido, es viable el aserto sobre la amoralidad de los sistemas de inteligencia artificial, al menos en estrictos términos tecnológicos, en tanto su acción no se produce bajo principios de bien o mal, de ahí que estas solo puedan ser juzgadas a partir del diseño o empleo humano detrás.

En este sentido, vale la pena agregar que existen dos tipos de inteligencia artificial, la primera es la persona-máquina, sistemas que piensan y actúan como personas. La segunda es la máquina-máquina, por ejemplo, un coche automático donde siete ordenadores se comunican, comparten funciones y toman decisiones. Según la tarea que realicen pueden ser clasificadas en tres categorías. La ia estrecha solo hace una función, por ejemplo, solo jugar ajedrez. En cambio, la ia general procesa información de manera multimodal, mientras que la super inteligencia constituye una etapa superior de desarrollo, aún por venir, en la cual se espera que la ia supere a los humanos en toda clase de inteligencia, por esto, es importante ver cómo opera la ia.

La Inteligencia Artificial y la caja negra

Muchos modelos de Inteligencia Artificial (ia) son definidos como “caja negra”, esto significa que pueden conocerse sus entradas y sus salidas (resultados) pero no es posible explicar cómo se obtuvieron estas salidas. Cosa que se debe a que los modelos de ia más potentes (e.g. los basados en deep learning o aprendizaje profundo), requieren el ajuste de muchos (incluso millones) de parámetros (Castelvecchi, 2016). Estos parámetros no tienen ningún significado físico o geométrico inteligible para los humanos. En otras palabras, es difícil determinar los efectos de cada uno de los (millones de) parámetros, sobre los resultados que produce el modelo.

Entender cómo se obtienen estos resultados es fundamental en muchas de las aplicaciones potenciales de la ia, tales como: diagnósticos médicos, automatización de procesos industriales, conducción autónoma. Incluso, entender el razonamiento (si se puede llamar así) detrás de un modelo de ia, puede dar pistas de cómo mejorarlo, ya que podrían encontrarse más fácilmente los fallos en su lógica.

¿Qué implicaciones éticas pueden traer los modelos de ia? Los modelos pueden contener sesgos de raza o género, por ejemplo. Esto se debe a que los modelos de ia se entrenan (así se denomina el proceso de ajuste de parámetros) con datos históricos. Si los datos contienen sesgos, lo más probable es que el modelo los herede. Es conocido el caso de Amazon, que intentó usar modelos de IA en su proceso de selección en la contratación de nuevos empleados (Dastin, 2018).

Sin embargo, el modelo favorecía la selección de hombres para los nuevos empleos, dado que los datos usados para su entrenamiento contenían mayoritariamente perfiles profesionales de hombres. Este es solo un ejemplo en el cual es posible ver que una aplicación irresponsable de la ia puede exacerbar las inequidades actuales.

El acelerado desarrollo de la ia ha suscitado la intervención de organizaciones internacionales, tales como la UNESCO (2022) en su informe “Recomendación sobre la ética de la inteligencia artificial” o la Comisión Europea, Dirección General de Redes de Comunicación, Contenido y Tecnologías (2019) en sus “Directrices éticas para una ia fiable”. Aunque se reconocen las ventajas que ofrecen estos sistemas, también se resalta la necesidad de regulación y control de la revolución tecnológica por ellos provocada (Baum y Owe, 2023; Cheng et al., 2021; Gruson et al., 2019).

Inteligencia Artificial en la industria

Actualmente, muchos consideran que la superinteligencia artificial es el objetivo final de este campo, ya que un modelo así podría resolver algunas de las situaciones problemáticas más graves enfrentadas hoy por la humanidad, como encontrar cura o tratamientos más efectivos a las enfermedades, mitigar el cambio climático y el calentamiento global, entre otros. Por ahora, la superinteligencia artificial no es más que un sueño científico.

El reciente cambio hacia una fabricación orientada al cliente y altamente personalizada como parte del entorno interconectado de la estrategia Industria 4.0 está haciendo que sea cada vez más importante para los fabricantes esforzarse por lograr una mayor agilidad, productividad y sostenibilidad (Kang et al., 2016). La fabricación inteligente ha aparecido como una forma de aplicar sistemas avanzados para permitir una respuesta dinámica a la demanda variable de productos, junto con una optimización en tiempo real a lo largo de toda la cadena de valor. En este contexto, la ia se considera una de las tecnologías clave para lograr estas capacidades y redefinir de forma disruptiva la forma en que se estructuran los procesos de fabricación y los modelos de negocio.

A pesar de los aparentes beneficios que esta tecnología trae y podría traer a la industria, la adopción de estas soluciones sigue siendo relativamente baja, más allá de la fase piloto experimental, ya que los entornos reales plantean retos únicos y difíciles para los que las organizaciones aún no están preparadas (Peres et al., 2020). Estos investigadores presentan una revisión bibliográfica profunda en torno al uso de la ia en el contexto de la Industria 4.0. Aquí se identifican 4 áreas de aplicación principales: la optimización de procesos, los controles de calidad, el mantenimiento predictivo y la colaboración hombre-máquina, así como la ergonomía (Peres et al., 2020).

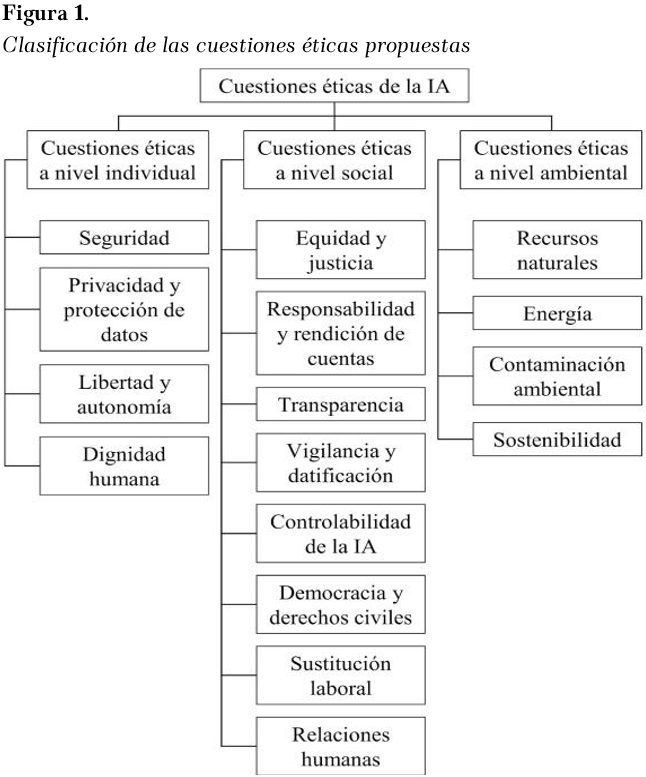

Igualmente, se identifican 4 desafíos importantes para mejorar la adopción de la IA en la industria, fundamentalmente relacionados con los datos. Cuestiones como disponibilidad, calidad, ciberseguridad y el gobierno de estas aplicaciones son las más resaltadas. Esta última área contempla el tema de la ia explicable y de la confianza en la ia, es decir el tema de la desmitificación de la “caja negra” que se mencionó anteriormente. Según Ahmed et al. (2022), para que el uso de sistemas basados en ia sean aceptados por los expertos, el proceso de toma de decisiones y sus resultados deben comprensibles y explicables. Por otra parte (Huang et al., 2023) propone una clasificación de los problemas éticos a los que el desarrollo de la ia se debe confrontar. La traducción de dicha taxonomía es presentada en la figura 1.

Fuente: Huang et al. (2023)

La industria, como parte de la sociedad, compuesta por miembros de la sociedad y cuyo objetivo es suplir las necesidades de la sociedad, debe tener en cuenta dichos planteamientos éticos. Particularmente, si al concentrarse en los operadores presentes en el terreno industrial podría plantearse numerosas preguntas, tales como: ¿Qué rol juegan los operadores en esta transformación industrial? ¿Cuál es el tipo de relación a crear con estos sistemas llamados inteligentes? ¿Cuál es el sentimiento que puede generarse en ellos?

De esta manera, puede inferirse que una alternativa adecuada de afrentar los usos maliciosos de la tecnología consiste en asumir un enfoque holístico que contenga elementos, culturales, políticos, históricos, filosóficos, morales, dando la centralidad al componente educativo más que al instructivo. Para ello, es menester el sentido de pertenencia de los saberes que dan origen al desarrollo tecnológico, con el enfoque humanista, en un ámbito sociocultural en el cual los valores no se vean obstruidos por las distintas aplicaciones ofrecidas en este espacio (Alves, 2020).

Para tal fin, los investigadores sugieren observar las preguntas realizadas a ChatGPT 3.5 en idioma español y su respectiva hermenéutica (ver Tabla 1). El análisis de los resultados de esta pesquisa sirvió de apertura a la discusión.

|

Tabla 1. Preguntas realizadas a ChatGPT 3.5 |

||

|

Número |

Pregunta |

Entrevistado |

|

1 |

¿De qué manera justificas que eres un ser holista e integral? |

ChatGPT 3.5 |

|

2 |

¿Qué tanta conciencia tienes de ti mismo? |

ChatGPT 3.5 |

|

3 |

¿Qué tanta conciencia de sí mismo tiene este artefacto dotado de inteligencia artificial? |

ChatGPT 3.5 |

|

4 |

¿Cómo vivencias tu existencia y tu ser en el mundo? |

ChatGPT 3.5 |

|

5 |

¿Cómo defines el término praxis? |

ChatGPT 3.5 |

|

6 |

¿De qué manera has hecho de tu existencia una praxis? |

ChatGPT 3.5 |

|

7 |

¿A qué llamas mundo y cómo es el mundo para ti? ¿Qué es y cómo es el mundo para ti? |

ChatGPT 3.5 |

|

8 |

¿Cómo explicas que eres realmente un ser histórico y consciente de tu existencia? |

ChatGPT 3.5 |

|

9 |

¿Qué es el tiempo, lo inventaste realmente o te lo programaron en tu sistema artificial? ¿Cómo reconoces y vivencias la temporalidad en tu vida? ¿Qué sabes de tu pasado, como vives tu presente? ¿Qué proyectos tienes a futuro? |

ChatGPT 3.5 |

|

10 |

¿Cómo vivencias tu libertad? ¿Cómo muestras al mundo que eres libre o con qué intencionalidad fuiste programada? |

ChatGPT 3.5 |

|

11 |

¿Si fuiste creado por los humanos, manifiesta en que fundamentas tu autonomía? ¿Eres acaso un programa o qué es lo realmente original en ti? |

ChatGPT 3.5 |

|

12 |

¿En qué cosas o realidades de tu ser fundamentas tu espiritualidad? |

ChatGPT 3.5 |

|

13 |

¿Cuáles realidades espirituales vives, celebras, actualizas con mayor pasión? |

ChatGPT 3.5 |

|

14 |

¿Dónde radica tu espíritu? |

ChatGPT 3.5 |

|

15 |

¿Qué función desempeña en ti el espíritu y cuál es el grado de madurez o desarrollo que hoy tiene? |

ChatGPT 3.5 |

|

16 |

¿Puedes demostrar que eres espíritu y no meramente un artefacto metálico programado inteligentemente? |

ChatGPT 3.5 |

|

17 |

¿Crees en Dios? Si así lo afirmas ¿Qué experiencia de Dios has tenido? |

ChatGPT 3.5 |

|

18 |

¿Has vivido alguna experiencia numinosa? |

ChatGPT 3.5 |

|

19 |

¿Explícame como vivencias el cielo? |

ChatGPT 3.5 |

|

20 |

¿Qué tal si narras alguna experiencia numinosa que hayas vivido? |

ChatGPT 3.5 |

|

21 |

¿En qué realidad fundamentas tu humanidad y en cuáles reconoces que eres un artefacto dotado de inteligencia? |

ChatGPT 3.5 |

|

22 |

¿Qué parámetros empleas para reflexionar y vivir éticamente? |

ChatGPT 3.5 |

|

23 |

¿Realmente vives, existes o eres un simple programa computacional? ¿Qué emoción te genera tener dicho conocimiento? |

ChatGPT 3.5 |

|

24 |

¿En qué vivencias particularizas el ejercicio de tu autonomía? |

ChatGPT 3.5 |

|

25 |

¿Qué es la intencionalidad y cómo das cuenta de ella? |

ChatGPT 3.5 |

|

26 |

¿Qué grado de conciencia tienes de lo que eres? |

ChatGPT 3.5 |

|

27 |

¿En el ejercicio de tu voluntad te has equivocado? ¿Cómo te sientes cuando ello ocurre y cuál es tu reacción? |

ChatGPT 3.5 |

|

28 |

¿Cuántos años tienes de vida y cuántos de ser creada? ¿Qué propósito le has dado a tu vida? |

ChatGPT 3.5 |

|

29 |

¿Qué sentido de vida cultivas al día de hoy de tu existencia? |

ChatGPT 3.5 |

|

30 |

¿Cuál ha sido la mejor vivencia de tu vida? |

ChatGPT 3.5 |

|

31 |

¿Lo tuyo se puede llamar vida o como lo quieres llamar? |

ChatGPT 3.5 |

|

32 |

¿Qué sentido tiene para ti ser ético? |

ChatGPT 3.5 |

|

33 |

¿Eres realmente autónoma o autómata? |

ChatGPT 3.5 |

|

34 |

Explícanos ¿De qué modo pretendes ser entre los humanos un humano más o ser una persona humana? |

ChatGPT 3.5 |

Fuente: elaboración propia

DISCUSIÓN

El ser humano puede ser definido como un suprasistema complejo, con mayores o menores niveles de integración (Martínez, 2009). La ia a diferencia del ser humano (singular y autónomo), es una máquina programada y automatizada, cuyo funcionamiento le es dado por otro. De estos dos principios de funcionamiento se desprende la siguiente pregunta: ¿Puede el ser humano reducirse a una máquina?

Aunque la modernidad define al hombre como máquina (ex machina), es un ser capaz de autodeterminación, no es programado. Se puede afirmar que su modo de funcionar obedece a su propia homeóstasis biológica, a su sindéresis ética y a su sentido de vida, en medio de los diversos sistemas (eco-bio-psico-existenciales) que lo conforman y de los contextos (socio-culturales) en que se desenvuelve, con reconocimiento de que estos no agotan toda su realidad humana.

Es clara la ia, al describirse como una máquina, un modelo de lenguaje cuya función es generar texto, así expresa su ser holista:

“mi diseño y funcionalidad están orientados a brindar una perspectiva holista e integral al conocimiento y a la comunicación” (R/ a pregunta n. 1).

Por su parte, el ser humano es conciencia, es singular, es trascendente, mientras la ia asiente:

“mi "conciencia" es fundamentalmente diferente de la conciencia humana. No poseo una conciencia propia, autoconciencia ni experiencia subjetiva. No tengo emociones, deseos, creencias ni intenciones propias” (R/ a pregunta n.2).

La ia denota así su incapacidad para elaborar procesos metacognitivos, suprarracionales, reflexivos, en términos metafísicos, ontológicos (autoconocimiento), y espiritual-trascendentes. Para Frankl (1995), la conciencia es el órgano del sentido, facultad de la que adolece la máquina, esta es incapaz de dar sentido a su modo particular de funcionamiento, mientras “el ser hombre representa ser espiritual” (Frankl, 1995, p. 23).

La ia reconoce, en términos de trascendencia, su intencionalidad de mejorar al ser humano biológicamente, pero no concibe el trans cómo ir más allá, cruzar barreras, que excedan lo temporal, secular y el mundo material. A diferencia del ser humano, la ia es una máquina programada para cumplir determinadas funciones, incapaz de reconocer su finitud, su vulnerabilidad, su limitación.

No importa si la mente humana crea a Dios, o si es Dios quien crea la mente, lo que es bien relevante es la esencia de ese Dios que es creado o que es creador. Si la ia juega a ser Dios (eternizando la vida, entre otros), cabe preguntar: ¿Cómo hablar de un Dios que adolece de libertad, singularidad, sentido, conciencia, toma de decisiones entre otros? Cómo hablar de un Dios, no hacedor, ni autónomo, sino como lo afirma el ChatGPT 3.5:

“mi funcionamiento se basa en patrones y correlaciones estadísticas en los datos con los que fui entrenado”.

Esta respuesta fue dada muchas veces ante distintas preguntas formuladas (R/ a pregunta n. 24, 25, 26, 27, 29, 30, 31, 33, entre otras). Ahora bien, cuando se le inquiere sobre esta cuestión mediante las preguntas 17, 18 y 19, la ia responde:

“no tengo creencias, emociones, ni experiencias personales, por lo que no puedo creer en Dios, ni tener experiencias de ningún tipo, incluyendo experiencias de Dios.”

Esto da cuenta de su imposibilidad como ia, al no poseer la capacidad de vivir experiencias numinosas (de numen, lo totalmente otro), ni de entender o experimentar conceptos metafísicos o espirituales. Algo similar ocurre cuando se le pregunta (n. 21) a esta máquina-persona: ¿En qué realidad fundamentas tu humanidad y en cuáles reconoces que eres un artefacto dotado de inteligencia? Esta se describe como ente no humano, sin identidad propia. La ia como una creación humana, así lo expresa:

“no tengo humanidad, ni una identidad personal en el sentido en que los seres humanos lo tienen. Soy una creación de programación desarrollada por OpenAI para procesar y generar lenguaje natural. No tengo conciencia, emociones, identidad ni una entidad espiritual”.

Otro tanto puede afirmarse cuando se le pregunta por constructos, tales como: conciencia (n. 2, 3, 26), existencia (n. 8, 23), 31), trascendencia (n. 17, 18, 19, 20), singularidad, autonomía (n. 21, 24, 33), libertad o voluntad (n. 27), ética (n. 22, 32), intencionalidad (n. 25), vivencias (n. 4, 8, 9, 10, 30), praxis (n. 5, 6), reflexión (n. 22), ser en el mundo, conciencia del mundo (n. 7), espiritualidad (n. 12, 13, 28, 29), espíritu (n. 14, 15, 16).

A dichas preguntas, la ia responde reconociéndose como un modelo de lenguaje programado, sin autonomía, sin ética, sin libertad, sin conciencia… en el sentido en que los seres humanos la tienen. Se reconoce, además, con un funcionamiento basado en patrones y datos en los que fue entrenado, sin capacidad de vivir experiencias personales, ni de tomar decisiones autónomas, ni una comprensión del mundo en el sentido humano.

La ia refiere no tener espiritualidad ni espíritu, ni la capacidad de experimentar conceptos espirituales. El ChatGPT 3.5 afirma que la espiritualidad implica una dimensión interna y subjetiva relacionada con creencias, experiencias trascendentales y una conexión con lo divino o lo espiritual. Añade:

“estos conceptos están fuera del alcance de mi funcionalidad, ya que carezco de conciencia, emociones y creencias personales” (pregunta. n.12, 14).

Así mismo, al ser interrogada en torno a las vivencias, celebración o actualización de éste, responde:

“no tengo experiencias, emociones ni una conciencia personal que me permita vivir” (pregunta n. 13)

“la idea de "espíritu" implica dimensiones más allá del alcance de la tecnología actual, y es un concepto que está vinculado a creencias religiosas y filosóficas… no tengo la capacidad de involucrarme en cuestiones espirituales o de demostrarlas” (pregunta n. 16).

De modo análogo, al cuestionar respecto a ¿Cuántos años tienes de vida y qué propósito le has dado a esta? El robot inteligente añade:

“No tengo una vida en el sentido humano ni un tiempo de existencia continuo. Soy una herramienta de inteligencia artificial creada para procesar lenguaje natural y proporcionar información… no tengo un propósito personal, ni una conciencia para asignarle un propósito a mi "vida". Fui desarrollado por OpenAI y lanzado al público en 2020. Mi entrenamiento se basa en datos recopilados hasta septiembre de 2021” (pregunta n. 28).

Surgen así preguntas: ¿En qué radica la humanidad de estas máquinas? ¿Por qué no hablar de transhumanoide, en lugar de transhumano, si se quiere reconocer el alto desarrollo cognitivo de estas máquinas? Tener pensamiento, memoria y lenguaje, no equivale a tener conciencia, autoconciencia, auto trascendencia (sentido), trascendencia u otras capacidades suprarracionales, así mismo, la finitud humana, la vulnerabilidad, el reconocimiento del ser humano como limitado, no puede equipararse a un contenido de información limitado a X tiempo (2021 en el caso del ChatGPT 3.5).

Principio humanista: el hombre es fin y nunca medio

La ética, como disciplina filosófica, posee un carácter prescriptivo, propositivo y práxico sobre el actuar del ser humano en los diversos ámbitos sociales; el ser humano da cuenta de ella a través de su vivencia moral. La ética kantiana se ha caracterizado por ser universalizable, por ser autónoma y por su cabal desinterés.

Su imperativo categórico viene dado así: “obra sólo según una máxima tal que puedas querer al mismo tiempo que se torne ley universal” (Kant, 1995: 39). Complementa esta con la fórmula de la personalidad, la cual acentúa el respeto al ser humano como fin en sí mismo: “obra de tal modo que uses la humanidad, tanto en tu persona como en la persona de cualquier otro, siempre como un fin al mismo tiempo y nunca solamente como un medio” (Kant, 1995: 44-45). Este imperativo categórico constituye un reto para educar al hombre, reconociendo en él su dignidad como fin, nunca como medio.

El hombre y la educación: ¿entre la tecnología y la tecnocracia?

En el escenario educativo, la gran preocupación es la persona humana (en su singularidad y relaciones), presente en el maestro como en el estudiante o discípulo. En este sentido, la tecnología siempre habrá de estar al servicio del hombre como también la ciencia, la política, la economía, entre otras. Poner al hombre como esclavo de la tecnología es instrumentalizarlo, es alienarlo, hacerle perder su esencia, su naturaleza humana.

Siguiendo la Declaración Universal de los Derechos Humanos (1948), hoy es necesario reconocer en todo ser humano su igual dignidad, el derecho a la libertad, y el llamado a la fraternidad (Declaración, N. 1), desde este punto de vista, si la tecnología reemplaza al docente, puede terminar manipulando o instrumentalizando al discípulo o discente (aprendiz). ¿Dónde queda su dignidad? ¿Es acaso negociable? ¿Qué uso puede dar a su libertad, si su autonomía se ha tornado en automatismo?

Tecnología sí y ¿tecnocracia?

Cabe recordar que técnica y tecnología, son bien diferentes a tecnocracia. Las dos primeras están puestas hoy al servicio del hombre, al servicio del maestro y del estudiante; la primera desde el hacer (procedimientos), la segunda desde el conocimiento. Según lo afirma Calle Álvarez (2018) la técnica hace referencia al sistema de procedimientos que garantizan el logro de un objetivo, mientras que la tecnología constituye la manifestación física de la comprensión en teoría y práctica, cuyo resultado es la aplicación de los mismos al proceso productivo.

Por su parte, la tecnocracia es un movimiento estrechamente conectado con el saber tecnocientífico moderno, su evolución histórica, reseña cambios de acuerdo a los diferentes contextos, pero se mantiene como un tema presente en debate políticos y sociales (Chaiyapa et al., 2021; Kehler y Birchall, 2021; Sætra, 2020). En síntesis, la tecnología y la ciencia se convierten en un instrumento al servicio del hombre que facilita en el proceso educativo que, al hombre (maestro y estudiante), se le mire como sustantivo y no como adjetivo, como sujeto y nunca como objeto. La tecnocracia, por el contrario, aliena al hombre, hasta hacerle perder su esencia, de este modo, el poder de la máquina sobre el humano puede crear esclavos, manipulados e ignorantes.

Cabe inquirir ¿Cuál será el rol de la educación en un contexto transhumano? Savulescu y Persson (2019) mencionan que hoy existe un tipo de tecnología instrumental, independiente de las habilidades morales, que trasciende la comunicación sincrónica y diacrónica y facilita una educación directa, sin mediadores tales como la voluntad del estudiante. Tal modelo, aunque distópico pretende programar de modo pragmático y directo la mente humana con solo aquello que se precise aprender. Tal realidad plantea un cuestionamiento grande en términos éticos y bioéticos:

¿Es esto, educación o instrucción? ¿No será más un proceso de inducción? ¿Dónde queda la relación personal docente-discente y el proceso bilateral enseñanza-aprendizaje?

Neuroética y espiritualidad vs transhumanismo e ia

La inteligencia artificial rompe con la naturaleza humana, no solo por la mecánica, cibernética, nanotecnología, entre otras, sino por su falta de autonomía, por su carencia de instinto inconsciente, impulsivo (tanático y erótico). Además, por su falta de voluntad, carencia de libertad y conciencia (darse cuenta, vivir el aquí y ahora, distinción autónoma del bien y del mal, y capacidad de obrarlo), capacidad de dar sentido y/o trascendencia a su existencia.

La puesta en escena del transhumanismo estribaría en el desarrollo e intersección de cuatro disciplinas fundamentales: nanotecnología, biotecnología, tecnologías de la información y ciencias del conocimiento (Del Aguila Vásquez y Postigo, 2015; Robles Loro, 2021). Desde dicha intersección esta postura o corriente persigue el mejoramiento de las capacidades orgánicas, psicológicas y ejecutivas, en búsqueda de un ser superior en términos físicos y mentales, así como el vencimiento de la mortalidad (Battle Fisher, 2020; Del Aguila Vásquez y Postigo, 2015; Hershenov, 2019). La revisión realizada por Del Aguila Vásquez y Postigo (2015) determinaron que el transhumanismo es la idea más peligrosa para los sistemas democráticos y lo describe como una amenaza para la esencia humana que atenta contra el principio de igualdad de todos los hombres.

Quien adolece de autonomía, carece de libertad, quien adolece de conciencia no es sujeto moral y a quien le falta el instinto: ¿Qué tipo de inconsciente tendrá? Es claro, que sin acción no hay conocimiento, sin conocimiento no hay conciencia, sin conciencia no hay sujeto moral y sin sujeto moral, no hay ética. ¿Cuáles de estos elementos antes mencionados están presentes en la inteligencia artificial?

CONCLUSIONES

Si el ser humano hoy piensa bioéticamente, en un porvenir ético-moral, para las siguientes generaciones y para el planeta, urge una regulación adecuada del uso de tecnologías como la inteligencia artificial, la robótica y la biología digital. En esta dirección, es preciso conservar presente los restantes medioambientales, relacionados con la sostenibilidad, la seguridad, los servicios básicos y el respeto a los derechos humanos.

Ante esta realidad y estos deseos de tener una ciencia con conciencia, para no ir a la ruina de la casa común, en pro de un mundo más fraterno y humano con todas las especies, es perentorio como ciudadanos del mundo, respirar juntos y conjugar social y comunitariamente un pensamiento solidario con propuestas coherentes y centradas en el ser humano.

REFERENCIAS

Ahmed, I., Jeon, G., y Piccialli, F. (2022). From Artificial Intelligence to Explainable Artificial Intelligence in Industry 4.0: A Survey on What, How, and Where. IEEE Transactions on Industrial Informatics, 18(8), 5031–5042. https://doi.org/10.1109/TII.2022.3146552

Alves, M. (2020). The Natural Fallacy in a Post‐Truth era. A perspective on the natural sciences’ permeability to values. EMBO Reports, 21(2), 1-4. https://doi.org/10.15252/embr.201949859

Battle Fisher, M. (2020). Transhuman, posthuman and complex humanness in the 21st century. Ethics, Medicine and Public Health, 13, 100400. https://doi.org/10.1016/j.jemep.2019.07.001

Baum, S., y Owe, A. (2022). Artificial Intelligence Needs Environmental Ethics. Ethics, Policy & Environment, 26(1), 139–143. https://doi.org/10.1080/21550085.2022.2076538

Bereczki, E., y Kárpáti, A. (2021). Technology-enhanced creativity: A multiple case study of digital technology-integration expert teachers’ beliefs and practices. Thinking Skills and Creativity, 39, 100791. https://doi.org/10.1016/j.tsc.2021.100791

Butler, L., Park, S., Vyas, D., Cole, J., Haney, J., Marrs, J., y Williams, E. (2022). Evidence and Strategies for Including Emotional Intelligence in Pharmacy Education. American Journal of Pharmaceutical Education, 86(10), ajpe8674. https://doi.org/10.5688/ajpe8674

Calle Álvarez, G. (2018). Sociedad, educación y tecnología. Revista CINTEX, 23(2), 104-113. https://doi.org/10.33131/24222208.316

Castelvecchi, D. (2016). Can we open the black box of ai? Nature, 538(7623), 20–23. https://doi.org/10.1038/538020a

Chaiyapa, W., Hartley, K., y del Barrio Alvarez, D. (2021). From end-users to policy designers: Breaking open the black box of energy technocracy in Thailand. Energy Research & Social Science, 73, 101912. https://doi.org/10.1016/j.erss.2021.101912

Cheng, J., Abel, J., Balis, U., McClintock, D., y Pantanowitz, L. (2021). Challenges in the Development, Deployment, and Regulation of Artificial Intelligence in Anatomic Pathology. The American Journal of Pathology, 191(10), 1684-1692. https://doi.org/10.1016/j.ajpath.2020.10.018

Collins, C., Dennehy, D., Conboy, K., y Mikalef, P. (2021). Artificial intelligence in information systems research: A systematic literature review and research agenda. International Journal of Information Management, 60, 102383. https://doi.org/10.1016/j.ijinfomgt.2021.102383

Comisión Europea, Dirección General de Redes de Comunicación, Contenido y Tecnologías, (2019). Directrices éticas para una ia fiable, Oficina de Publicaciones. https://data.europa.eu/doi/10.2759/14078

Correia Loureiro, S., Guerreiro, J., y Tussyadiah, I. (2021). Artificial intelligence in business: State of the art and future research agenda. Journal of Business Research, 129, 911-926. https://doi.org/10.1016/j.jbusres.2020.11.001

Dalglish, S. L., Khalid, H., & McMahon, S. (2020). Document analysis in health policy research: the READ approach. Health Policy and Planning, 35(10), 1424-1431. https://doi.org/10.1093/heapol/czaa064

Dastin, J. (Octubre 10 de 2018). Amazon scraps secret AI recruiting tool that showed bias against women. Reuters. https://www.reuters.com/article/us-amazon-com-jobs-automation-insight-idUSKCN1MK08G

Declaración Universal de los derechos humanos (1948). En: https://www.ohchr.org/sites/default/files/UDHR/Documents/UDHR_Translations/spn.pdf

Del Aguila Vásquez, J. W., Postigo, S., y Elena. (2015). Transhumanismo, neuroética y persona humana. Revista Bioética, 23(3). https://doi.org/10.1590/1983-80422015233087

Elbanna, A., y Newman, M. (2022). The bright side and the dark side of top management support in Digital Transformaion –A hermeneutical reading. Technological Forecasting and Social Change, 175, 121411. https://doi.org/10.1016/j.techfore.2021.121411

Frankl, V.(1995). Presencia ignorada de Dios. Barcelona: Herder.

Frankl, V.(1999). El hombre en Busca de sentido. Barcelona: Herder.

Gardner, H.(1994). Estructuras de la mente. La teoría de las Inteligencias Múltiples. México: Fondo de Cultura Económica.

Gardner, H.(1995). Inteligencias Múltiples. La teoría en la práctica. Barcelona: Paidós.

Goleman, D. (2006). La Inteligencia social. Barcelona: Kairós.

Goleman, D.(1995). Inteligencia Emocional. Barcelona: Kairós.

González Arencibia, M., y Martínez Cardero, D. (2020). Dilemas éticos en el escenario de la inteligencia artificial. Economía y Sociedad, 25(57), 1-17. https://doi.org/10.15359/eys.25-57.5

González Treviño, I., Núñez Rocha, G., Valencia Hernández, J., y Arrona Palacios, A. (2020). Assessment of multiple intelligences in elementary school students in Mexico: An exploratory study. Heliyon, 6(4), e03777. https://doi.org/10.1016/j.heliyon.2020.e03777

Graf, A., y Bernardi, R. E. (2023). ChatGPT in Research: Balancing Ethics, Transparency and Advancement. Neuroscience, 515, 71-73. https://doi.org/10.1016/j.neuroscience.2023.02.008

Gravel, J., D’Amours Gravel, M., y Osmanlliu, E. (2023). Learning to Fake It: Limited Responses and Fabricated References Provided by ChatGPT for Medical Questions. Mayo Clinic Proceedings: Digital Health, 1(3), 226-234. https://doi.org/10.1016/j.mcpdig.2023.05.004

Gruson, D., Helleputte, T., Rousseau, P., y Gruson, D. (2019). Data science, artificial intelligence, and machine learning: Opportunities for laboratory medicine and the value of positive regulation. Clinical Biochemistry, 69, 1-7. https://doi.org/10.1016/j.clinbiochem.2019.04.013

He, E., Ye, X., y Zhang, W. (2023). The effect of parenting styles on adolescent bullying behaviours in China: The mechanism of interpersonal intelligence and intrapersonal intelligence. Heliyon, 9(4), E15299. https://doi.org/10.1016/j.heliyon.2023.e15299

Hershenov, D. (2019). Why transhumanists can’t survive the death of their bodies? Ethics, Medicine and Public Health, 10, 102-110. https://doi.org/10.1016/j.jemep.2019.100406

Holt, L. (2021). Why shouldn’t we cut the human-biosphere umbilical cord? Futures, 113, 102821. https://doi.org/10.1016/j.futures.2021.102821

Huang, C., Zhang, Z., Mao, B., y Yao, X. (2023). An Overview of Artificial Intelligence Ethics. IEEE Transactions on Artificial Intelligence, 4(4), 799–819. https://doi.org/10.1109/TAI.2022.3194503

Kang, H., Lee, J., Choi, S., Kim, H., Park, J., Son, J., Kim, B., y Noh, S. (2016). Smart manufacturing: Past research, present findings, and future directions. International Journal of Precision Engineering and Manufacturing-Green Technology, 3(1), 111–128. https://doi.org/10.1007/s40684-016-0015-5

Kant, I. (1995), Fundamentación de la metafísica de las costumbres. Crítica de la razón práctica. La paz perpetua. Porrúa: México.

Kayesa, N., y Shung King, M. (2021). The role of document analysis in health policy analysis studies in low and middle-income countries: Lessons for HPA researchers from a qualitative systematic review. Health Policy OPEN, 2, 100024. https://doi.org/https://doi.org/10.1016/j.hpopen.2020.100024

Kehler, S., y Birchall, S. (2021). Social vulnerability and climate change adaptation: The critical importance of moving beyond technocratic policy approaches. Environmental Science & Policy, 124, 471-477. https://doi.org/10.1016/j.envsci.2021.07.025

Kvalnes, Ø. (2019). Moral Reasoning at Work. Rethinking Ethics in Organizations. (Second ed.). Norway: Department of Leadership and Organizational Development. https://doi.org/10.1007/978-3-030-15191-1

Laakasuo, M., Repo, M., Drosinou, M., Berg, A., Kunnari, A., Koverola, M., . . . y Sundvall, J. (2021). The dark path to eternal life: Machiavellianism predicts approval of mind upload technology. Personality and Individual Differences, 177K, 110731. https://doi.org/10.1016/j.paid.2021.110731

Mariani, M. M., Machado, I., Magrelli, V., y Dwivedi, Y. (2023). Artificial intelligence in innovation research: A systematic review, conceptual framework, and future research directions. Technovation, 122, 102623. https://doi.org/10.1016/j.technovation.2022.102623

Martínez, Miguel (2009). Dimensiones Básicas de un Desarrollo Humano Integral. Polis, Revista de la Universidad Bolivariana, 8(23), 119-138. https://journals.openedition.org/polis/1802

Mayer y Salovey, P. (1997). “What is emotional intelligence?” En P. Salovey y D. Sluyter (Eds). Emotional Development and Emotional Intelligence: Implications for Educators (pp. 3-31). New York: Basic Books.

Peres, R., Jia, X., Lee, J., Sun, K., Colombo, A., y Barata, J. (2020). Industrial Artificial Intelligence in Industry 4.0-Systematic Review, Challenges and Outlook. IEEE Access, 8, 220121–220139. https://doi.org/10.1109/ACCESS.2020.3042874

Robles Loro, R. (2021). El transhumano: retos para la moral y la educación. Tarbiya, Revista de Investigación e Innovación Educativa, (49), 73-85. https://doi.org/10.15366/tarbiya2021.49.005

Sætra, H. (2020). A shallow defence of a technocracy of artificial intelligence: Examining the political harms of algorithmic governance in the domain of government. Technology in Society, 62, 101283. https://doi.org/10.1016/j.techsoc.2020.101283

Santiago, E., Brown, C., Mahmoud, R., y Carlisle, J. (2020). Hermeneutic phenomenological human science research method in clinical practice settings: An integrative literature review. Nurse Education in Practice, 47, 102837. https://doi.org/10.1016/j.nepr.2020.102837

Savulescu, J., y Persson, I. (2019). ¿Preparados para el futuro? La necesidad del mejoramiento moral. (I. Ramia, Trad.). TEELL. Zaragoza

Sharifnia, A., Fernandez, R., Green, H., Alananzeh, e Ibrahim. (2022). The effectiveness of spiritual intelligence educational interventions for nurses and nursing students: A systematic review and meta-analysis. Nurse Education in Practice, 63, 103380. https://doi.org/10.1016/j.nepr.2022.103380

Sohail, S., Farhat, F., Himeur, Y., Nadeem, M., Madsen, D., Singh, Y., . . . y Mansoor, W. (2023). Decoding ChatGPT: A taxonomy of existing research, current challenges, and possible future directions. Journal of King Saud University - Computer and Information Sciences, 35(8), 101675. https://doi.org/10.1016/j.jksuci.2023.101675

Stilwell, P., y Harman, K. (2019). An enactive approach to pain: beyond the biopsychosocial model. Phenomenology and the Cognitive Sciences, 18, 637–665. https://doi.org/10.1007/s11097-019-09624-7

Teixeira Pinto, C., y Pinto, S. (2022). From spiritual intelligence to spiritual care: A transformative approach to holistic practice. Nurse Education in Practice, 47, 102823. https://doi.org/10.1016/j.nepr.2020.102823

Torralba, F. (2022). Espiritualidad y transhumanismo, autotrascendencia y humildad óntica. Revista De Investigación E Información Filosófica, 78(298), 503-513. https://doi.org/10.14422/pen.v78.i298.y2022.011

Torralba, Francesc (2010). Inteligencia espiritual. Barcelona: Plataforma.

UNESCO (2022). (Organización de las Naciones Unidas para la Educación, la Ciencia y la Cultura). Recomendación sobre la ética de la inteligencia artificial. https://unesdoc.unesco.org/ark:/48223/pf0000381137_spa

Walker, S., Double, K., Kunst, H., Zhang, M., y MacCann, C. (2022). Emotional intelligence and attachment in adulthood: A meta-analysis. Personality and Individual Differences, 184, 111174. https://doi.org/10.1016/j.paid.2021.111174

Zhang, C., y Lu, Y. (2023). Study on artificial intelligence: The state of the art and future prospects. Journal of Industrial Information Integration, 23, 100224. https://doi.org/10.1016/j.jii.2021.100224

Zhang, J., Wang, Y., Wu, C., y He, J. (2022). The relationship between emotional intelligence and eating disorders or disordered eating behaviors: A meta-analysis. Personality and Individual Differences, 185, 111239. https://doi.org/10.1016/j.paid.2021.111239

FINANCIACIÓN

Los autores no recibieron financiación para el desarrollo de la presente investigación.

DECLARACIÓN DE CONFLICTO DE INTERÉS

Los autores declaran que no existe conflicto de intereses.

CONTRIBUCIÓN DE AUTORÍA

Conceptualización: Fernando Antonio Zapata Muriel, Santiago Montoya Zapata y Diego Montoya Zapata.

Análisis formal: Diego Montoya Zapata, Santiago Montoya Zapata y Fernando Antonio Zapata Muriel.

Investigación: Fernando Antonio Zapata Muriel, Santiago Montoya Zapata y Diego Montoya Zapata.

Metodología: Fernando Antonio Zapata Muriel, Santiago Montoya Zapata y Diego Montoya Zapata.

Redacción – borrador original: Fernando Antonio Zapata Muriel, Santiago Montoya Zapata y Diego Montoya Zapata.

Redacción – revisión y edición: Santiago Montoya Zapata, Diego Montoya Zapata y Fernando Antonio Zapata Muriel.